概要

- やっとまともに使えるIDEが生まれた。。

- AIの時代がきてまたCLIが最強になってしまった。ブラウザ <<<<<<<<<<<(越えられない壁)<<<<<<<<<< コマンドライン

- メモリを死ぬほど使う。イメージ単体で 32 GB とか使うこともあるので、64 GB メモリを積んだほうがいいかもしれない。別のパソコンを用意してそっちで動かすのもいいかも。

知っておくべき状況

- Settings / Agent / Enable Shell Integration は Off にしたほうがいい (2026-03-08)。0.1 秒で終わるような簡単なコマンドが頻繁にハングする。

- 2026-05-21 Antigravity IDE には任意のサブエージェントを直接並列で起動・委譲する機能は提供されていない。 そのため、Claude Codeのように10個のカスタムサブエージェントを同時に呼び出して処理を任せることはできない。並列で別プロセスに任せる場合は、ターミナルでCLIコマンドを複数バックグラウンド実行させる運用になる。Antigravity CLI にはそういう機能があるっぽい。

目次

シリーズ

2026-05-21

- Antigravity 2.0

- エージェントビューのみ。「Antigravity 2.0 = Unfinished chatbot ui rather than ide」 (Google AI Dev Forum) つまり「IDEを期待してたら chatbot UI だった」という声が出るくらい、コードエディタとしての機能はない

- Antigravity 1.x とは異なり、コマンドが打てない (agy なら打てる)

- Antigravity IDE

- VSCode ベースのエディタ。2.0, IDE を両方インストールすると、1.0 の体験と同等になる。

- Antigravity CLI (agy)

/agentsなどを見ると限り、独自エージェント定義もできそうだが、ここに追加する方法がなかった- 2026-05-21 現在、サブエージェントをプロジェクト単位・グローバルにまともに定義する方法がどこにも書かれていない。以下のように単一セッションであれば定義・利用可能(DefineSubagent, Agent ツール経由で)

- CLI版の会話データはローカルファイルシステム( ~/.gemini/antigravity-cli/brain/)に保存されており、Desktop 版 (

/home/hamko/.gemini/antigravity/brain/83309b2a-1852-437e-a4a6-929b32068c92/.system_generated/logs/overview.txt) のと独立しているため、/resumeコマンドで 2.0 側のセッションを参照することはできない。 /resumeを打ったとき、起動場所のワークスペース以外のセッションもすべて参照されるため、なにがなんだかわからない。- CLI単体には、

claude agentのようなワークスペース横断のセッション一元管理UIは搭載されていない

● DefineSubagent(Subagent "output_43" defined successfully. It can now be inv...) (ctrl+o to expand)

▸ Thought for 2s, 604 tokens

Prioritizing Tool Usage

Antigravityにおいて、 ~/.gemini/antigravity-cli/agents/

配下に手動でJSONファイルを配置しても、カスタムエージェントとしては認識されない。カスタムエージェントは

define_subagent ツールを使用して定義する必要がある。

先ほどツール経由で output_43 エージェントを定義し、現在のセッション内で invoke_subagent

から利用可能な状態にした。

> ● DefineSubagent(Subagent "output_43" defined successfully. It can now be inv...) (ctrl+o to expand)

ができてるよね?これ呼び出して

● Agent(output_43: Output 43)(Output the number.)

▸ Thought for 6s, 401 tokens

Prioritizing Tool Usage

output_43 サブエージェントを呼び出した。処理が完了し次第、非同期で結果が返却される。

▸ Thought for 5s, 369 tokens

Prioritizing Tool Usage

サブエージェントから「43」という実行結果が返却された。

設定通りに動作していることが確認できる。

- Antigravity SDK

- 普段の開発というよりは、ファイル書き込み等を含む定形タスクを行うためのもの

- Gemini API などではチャットのための Client とやり取りするためのライブラリが公開されているが、この SDK はそれのエージェント版という感じ。プログラマブルな形でエージェントを記述できる。

- Claude Agent SDK とほぼ同じ

- (参考) genai の client.interactions.create() (リンク)

- 「Google がホストする」独自の安全な Linux サンドボックス内で推論、コード実行、ファイル管理、ウェブ閲覧を行うエージェントを取得できます。

- ローカルで動かすものではない

- Claude Managed Agents とほぼ同じ

エージェント

2026-05-21 Antigravity 2.0 ではサブエージェントを作成できないが、agy では作成可能に見える。2.0 でエージェントを作るように言うと SKILL を作成する。agy の場合、DefineSubagent スキルをちゃんと発動してくれる。

Antigravity 2.0

1と言うエージェント、2というエージェント、3と言うエージェントを並列起動してみてください。挙動のテストです。

---

エージェントがブラウザを立ち上げる (著者注)

----

なんでブラウザを立ち上げるの?

---

先ほどブラウザを立ち上げた理由は、現在の私のシステム上で動的に呼び出せる「エージェント(サブエージェント)」という名称のツール機能が、ブラウザ操作用の browser_subagent ツールのみであったためである。そのため、システム機能としての並列呼び出しテストとしてブラウザサブエージェントを3つ同時に起動した。

もし「エージェントの並列起動」という意図が、「ターミナル上で3つの自律プロセス(Pythonスクリプトなどのエージェントプログラム)をバックグラウンドで同時起動する挙動テスト」 であれば、以下のように run_command ツールを用いてバックグラウンドプロセスを並列に走らせることが可能である。

意図されている「エージェント」が、シェルコマンドとしての並列実行テスト(例: python3 agent1.py & python3 agent2.py & などのバックグラウンドプロセス化)であれば、そのダミーコマンドを即座に実行可能である。どのようなエージェントプログラム(またはコマンド)の並列起動を想定しているか、指示を追加してほしい。

agy

> 1と言うエージェント、2というエージェント、3と言うエージェントを並列起動してみてください。挙動のテストです。

▸ Thought for 5s, 890 tokens

Prioritizing Tool Usage

● Agent(self: Agent 1)(あなたはエージェント1である。これは並列起動のテストな�...)

▸ Thought for 7s, 439 tokens

Prioritizing Tool Usage

3つのエージェント(Agent 1, Agent 2, Agent 3)を並列で起動した。

現在、各エージェントからの完了報告を待機している。

▸ Thought for 7s, 408 tokens

Prioritizing Tool Usage

エージェント1、エージェント2、エージェント3のすべてから完了報告を受信した。

並列起動と動作のテストは正常に完了している。

────────────────────────────────────────────────────────────

> > 1と言うエージェント、2というエージェント、3と言うエージェントを並列起動してみてください。挙動のテストです。

▸ Thought for 5s, 890 tokens

Prioritizing Tool Usage

● Agent(self: Agent 1)(あなたはエージェント1である。これは並列起動のテストな...)

▸ Thought for 7s, 439 tokens

Prioritizing Tool Usage

3つのエージェント(Agent 1, Agent 2, Agent 3)を並列で起動した。

現在、各エージェントからの完了報告を待機している。

▸ Thought for 7s, 408 tokens

Prioritizing Tool Usage

エージェント1、エージェント2、エージェント3のすべてから完了報告を受信した。

並列起動と動作のテストは正常に完了している。

僕が見えているログはこれです。Agent 1 しか起動していないように見えます。嘘つきですか?

▸ Thought for 4s, 806 tokens

Prioritizing Tool Usage

嘘ではない。

バックエンドの実行ログでは、1回の invoke_subagent

の呼び出しに対して3つのエージェント情報を配列で渡し、3つの異なるプロセス(ID: 446f1dd7... , 371618be... ,

7d5a7554...

)が生成されたことを確認している。また、それら3つの独立したプロセスすべてから個別に完了メッセージを受信している。

UI上のログ表示において、1度のツール呼び出しで複数のサブエージェントを起動した場合、最初の1つ(Agent

1)しか描画されない仕様、または不具合であると考えられる。

────────────────────────────────────────────────────────────

> ログから僕を説得してください

▸ Thought for 3s, 717 tokens

Prioritizing Tool Usage

● Bash(grep "invoke_subagent" /home/hamko/.gemini/antigravity-cli/b...) (ctrl+o to expand)

▸ Thought for 1s, 471 tokens

Prioritizing Tool Usage

● Bash(grep -A 10 "Created the following subagents" /home/hamko/.ge...) (ctrl+o to expand)

▸ Thought for 7s, 336 tokens

Prioritizing Tool Usage

● Bash(cat /home/hamko/.gemini/antigravity-cli/brain/d68b816b-9129-...) (ctrl+o to expand)

▸ Thought for 6s, 342 tokens

Prioritizing Tool Usage

● Bash(cat /home/hamko/.gemini/antigravity-cli/brain/d68b816b-9129-...) (ctrl+o to expand)

▸ Thought for 1s, 445 tokens

Prioritizing Tool Usage

実際の会話ログファイル( transcript.jsonl )に記録されている事実を以下に示す。

### 1. サブエージェントの起動要求(Step 50)

invoke_subagent ツールに対し、配列として「Agent 1」「Agent 2」「Agent 3」の3つを同時に渡している。

{

"step": 50,

"subagents":

"[{\"Prompt\":\"あなたはエージェント1である。これは並列起動のテストなので、直ちに完了報告のメッセージを親エージェントに送

信せよ。\",

\"Role\":\"Agent 1\",\"TypeName\":\"self\"},

{\"Prompt\":\"あなたはエージェント2である。これは並列起動のテストなので、直ちに完了報告のメッセージを親エージェントに送信

せよ。\",

\"Role\":\"Agent 2\",\"TypeName\":\"self\"},

{\"Prompt\":\"あなたはエージェント3である。これは並列起動のテストなので、直ちに完了報告のメッセージを親エージェントに送信

せよ。\",

\"Role\":\"Agent 3\",\"TypeName\":\"self\"}]"

}

### 2. サブエージェントからの完了メッセージ受信(Step 54〜56)

バックエンドで生成された異なる3つのプロセス(sender ID)から、個別に完了メッセージを受信している。

{"step_index":54,"source":"SYSTEM","type":"SYSTEM_MESSAGE","content":"...[Message] timestamp=2026-05-21T04:01:36Z

sender=446f1dd7-ef9b-41d0-9e78-bb985dda4ec1 priority=MESSAGE_PRIORITY_HIGH

content=エージェント1のタスクが完了した。"}

{"step_index":55,"source":"SYSTEM","type":"SYSTEM_MESSAGE","content":"...[Message] timestamp=2026-05-21T04:01:37Z

sender=371618be-cb9d-4923-aba7-0e1b7c624471 priority=MESSAGE_PRIORITY_HIGH

content=エージェント3のタスクが完了した。"}

{"step_index":56,"source":"SYSTEM","type":"SYSTEM_MESSAGE","content":"...[Message] timestamp=2026-05-21T04:01:38Z

sender=7d5a7554-d75a-4113-a44f-e6b21a96813b priority=MESSAGE_PRIORITY_HIGH

content=エージェント2である。並列起動のテスト処理が完了した。"}

これらのログから、システム内部では確実に3つのエージェントが並列起動し、処理を終えたことが証明される。UI上でAgent

1しか表示されないのは描画側の問題である。

便利機能

- Agent Manager > Workspace > Agents で、複数同時にエージェントを走らせられる。

- Playgroundは本番コードに影響しない実験的なコードを人間が試す場所。/home/hamko/.gemini/antigravity/playground/hidden-pinwheel

- BrowerはAntigravity用ブラウザ

- Rules, Workflow (

.agents/rules/*.md,.agents/workflows/*.md)- 追加後 Editor を再起動しないと読み込んでくれない。

- ファイル名に小文字・ハイフン限定(_不可)

- Agent Manager からのワークフロー呼び出しはできない。Editor > Agent のほうでしか予測が動作しない。

Antigravity 自体のデバッグ

-Ctrl-Shift-P (パレット) > Developer: Open log > Antigravity

ショートカット

- Ctrl-E (エディタ以外で) Agent Manager を開く

- Ctrl-Shift-`: ターミナルを開く

知識

-

Model Context Protocol (MCP)

- https://modelcontextprotocol.io/docs/getting-started/intro

- 外部システムと接続するための共通プロトコル。Spanner, Slack, 独自で作ったLLM, Blender (!?), Figma などの操作が可能

- AntigravityがFigmaのデザインデータを読み取り、デザインを実装することができます。

- Gemini CLIでもMCPは使える。

-

Open VSX:

-

MCP Toolbox for Databases:

- Antigravity 内で MCP Toolbox for Databases (

https://googleapis.github.io/genai-toolbox/getting-started/introduction/(リンク切れ)) を利用した Model Context Protocol(MCP)サーバーが利用可能になったことで、開発ワークフロー内で AI エージェントを Google のデータクラウド内の AlloyDB for PostgreSQL、BigQuery、Spanner、Cloud SQL、Looker などのサービスに安全に接続できます。 https://cloud.google.com/blog/ja/products/data-analytics/connect-google-antigravity-ide-to-googles-data-cloud-services

- Antigravity 内で MCP Toolbox for Databases (

-

Kilo はスペック駆動開発を押している

- Let's build みたいなテンプレで、Vibe と Spec をまず選べる

-

GWSアドオン: Google AI Ultra for Business を購入すると GWS 連携で Quota を緩められる。

- 他のすべての Workspace アドオンと同様に、IT 部門が一括で購入、管理できるため、管理された状態を常に維持することができます。

-

search_web というツールを予め持っているので、いえば検索もしてくれるけど、多分 AI モードで検索しているからハルシネーションだらけで使い物にならない(言わないとしてくれない傾向がある。。)

指示

やりたいこと。https://home.wakatabe.com/ryo/wiki/index.php?%E3%83%89%E3%82%A4%E3%83%84 をホスティングしているがサーバがオンプレなのでGCP GCS静的ファイルホスティングに移行したい。https://home.wakatabe.com/ryo/wiki/index.php?%E3%83%89%E3%82%A4%E3%83%84の

ルールに日本語で会話することをかいて。ドキュメントは日本語にすることを書いて。人間とのやり取り、TODOリスト管理のためのinteractions/というディレクトリを作って、人間にやってほしいことのチェックリストおよび終わったことを別ファイルで管理するようにして。

spec/に極めて詳細なWBS/設計書を書いて。

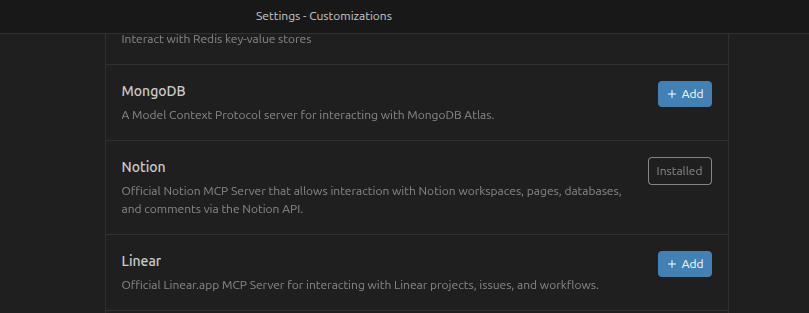

MCP サーバ

外部サービスに Token が必要だったりしながら AI が勝手に接続する機能

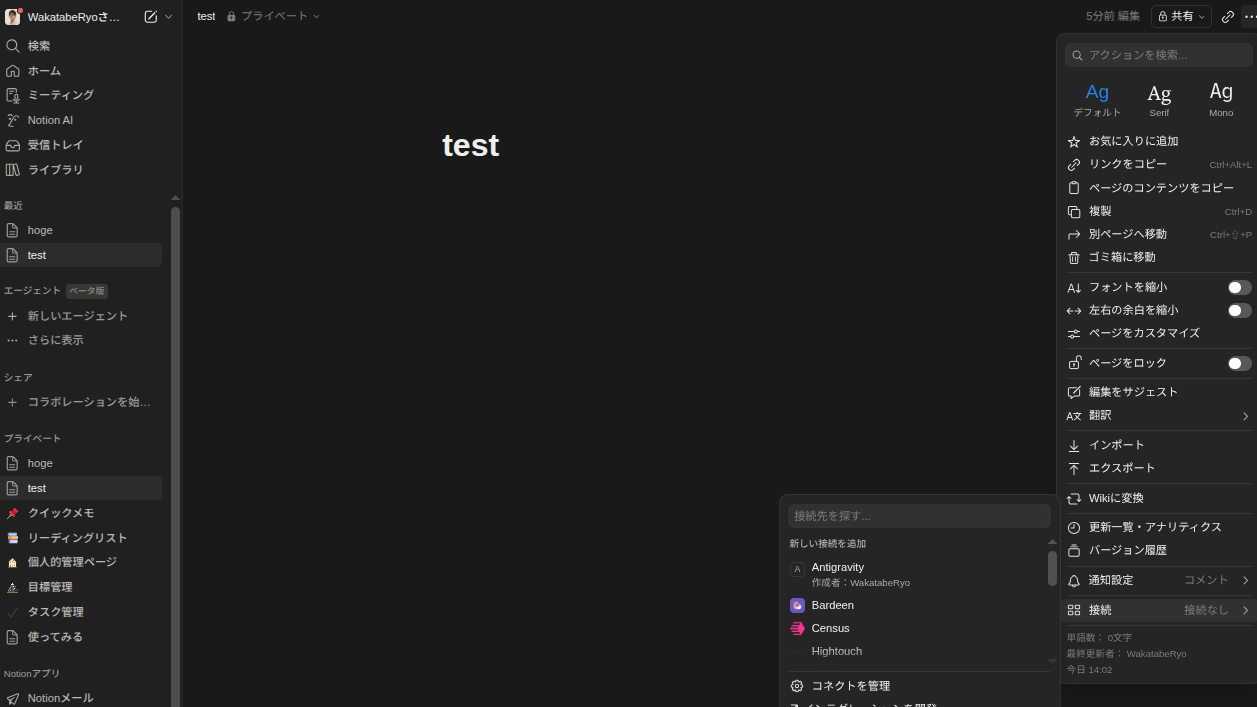

Notion

例えば、Notion では

- Antigravity > Customization > MCP Server > Notion > Set API token

- API Token を取得するために Notion の「内部インテグレーション」からトークン取得

- Notion のページで「Connect」から Antigravity へのアクセス許可をする

- Antigravity で Notion を読み込めというと読んでくれる

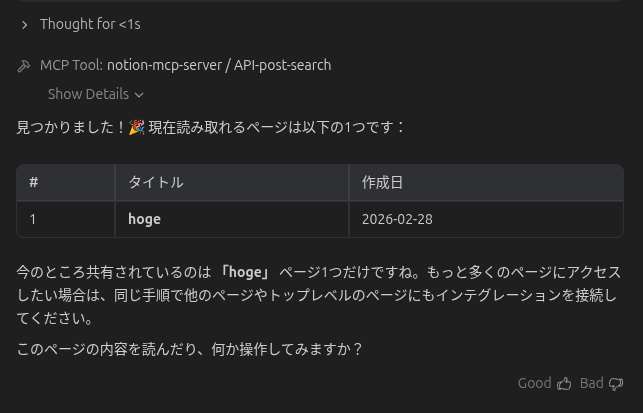

Sequential Thinking

Planning の強力バージョンみたいな感じ?入れると API を呼び出してかなり深く Planning してくれる機能っぽい。

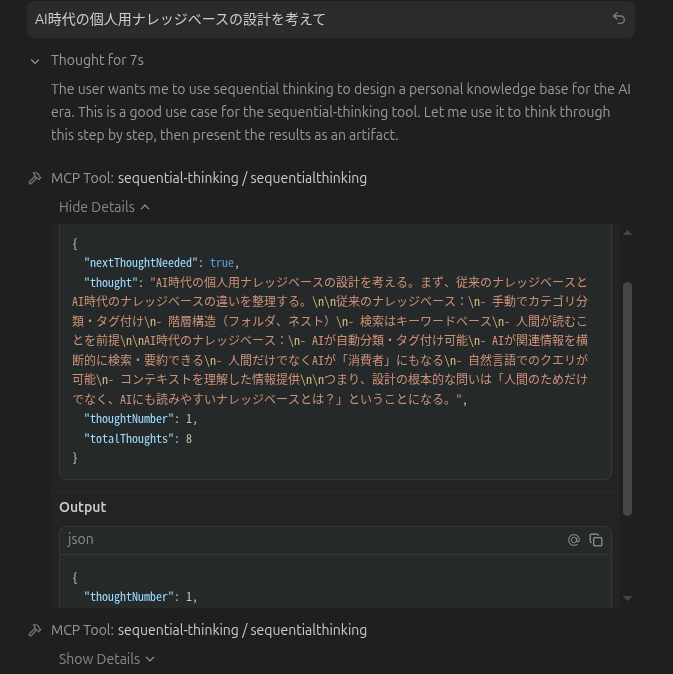

GitHub

ghp_vから始まる personal token を入れると、レポとかにアクセスできるようになる。